被「偷臉」成A片主角-Deepfake目前無法可管?

網紅小玉利用AI換臉技術販賣「Deepfake成人影片」,牟取不法獲利約1100萬元,其受害者除知名網紅、藝人明星,也不乏女性政治人物,初估受害者至少上百人。

Deepfake技術,中文譯作「深偽」,是透過AI人工智慧中的「深度學習(deep learning)」所創造出的假(fake)訊息。Deepfake技術只需仿造對象的人物影音素材,就能製造出唯妙唯肖的假影片。

Deepfake最初常見於選舉期間攻擊政治人物的造假影片,而這項技術沒多久就被應用到色情影片上,例如2017年就曾出現《神力女超人》女主角蓋兒加朵(Gal Gadot)遭換臉的「造假色情片」。Deepfake除產生出數位性暴力的問題外,這項AI技能輕易地傳遞出令人難以辨別的假訊息,讓「眼見不一定為憑」。

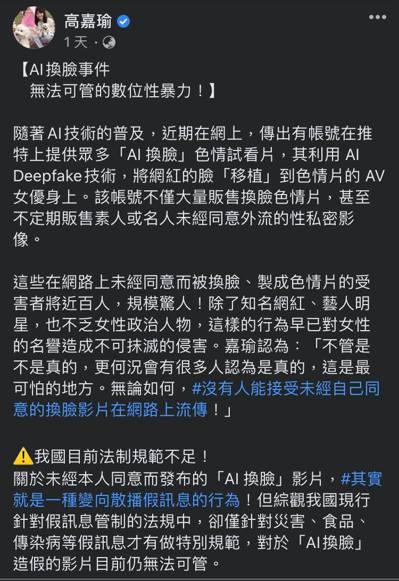

在此次事件中同為受害者的立委高嘉瑜,批評這是「無法可管的性暴力」。她在臉書發文表示,未經本人同意而發布的「Deepfake換臉影片」,其實就是一種變相散播假訊息的行為,早已對女性的名譽造成不可抹滅的侵害。但綜觀現行針對假訊息管制的法規中,卻僅針對災害、食品、傳染病等假訊息才有做特別規範,對於AI換臉造假仍無法可管。

高嘉瑜表示,她將參考國際作法,致力推動台灣AI換臉管制的相關法令,包括建立獨立的網路影像真實性查核單位、提高網路平台對於用戶發布內容之監督責任、將AI換臉的濫用視為獨立犯罪行為。

有鑑於濫用Deepfake技術的亂象,社群平台與微軟皆出手管制,如Facebook宣布全面封鎖利用Deepfake技術的造假影片,Twitter則會明確標注「假訊息」。微軟則推出驗證工具,透過分析影片中每一幀(frame)是否有邊緣模糊、灰階色素遭竄改等方式給出可信度分數。

延伸閱讀